Algorithmen-Monitoring

Vor dem Hintergrund des immensen Potenzials von Algorithmen sowie ihrer wachsenden Bedeutung bei technologischen Entwicklungen auf der einen Seite und der wachsenden algorithmischen Komplexität, der Intransparenz und der steigenden Herausforderungen, die diese Entwicklung mit sich bringt, auf der anderen, startete die Initiative D21 2018 eine Unterarbeitsgruppe (UAG) der AG Digitale Ethik zur Bearbeitung von Fragestellungen rund um das Thema „Algorithmen-Monitoring“.

Expert*innen aus Wissenschaft, Wirtschaft, Verwaltung und Zivilgesellschaft haben knapp zwei Jahre in der UAG zusammengearbeitet und relevante Fragestellungen diskutiert. Sie identifizieren folgende relevante Themenkreise:

- Sozio-ökonomischer Kontext: Welche sozialen und ökonomischen Vor- und Nachteile entstehen durch Algorithmen und kann man diesen gegebenenfalls entgegenwirken? Welche Auswirkungen auf Mensch und Gesellschaft sind zu erwarten? Weitere Fragen entstehen rund um die Wahrnehmung politischer Ereignisse, die Entwicklung von sogenannten „Echo Chambers“ und die cross-sektorale Veränderung von Arbeit wie wir sie bisher kennen?

- Technologischer Kontext: Durch die hohe Komplexität der Algorithmen, die mit dem maschinellen Lernen verbundenen sind, ist die konzeptionelle Gestaltung eines Monitorings nicht ohne technische Expertise umzusetzen. Wie kann man ein Algorithmen-Monitoring entwickeln? Mit welchen Schwierigkeiten ist zu rechnen?

- Rechtlich-Ethischer Kontext: Welche ethischen Fragen haben Einfluss auf die Gesetze in einer Gesellschaft? Welche legislativen Schritte müssten erfolgen, um Algorithmen regulieren zu können? Welche rechtliche Grundlage sichert die faire Regulierung algorithmischer Systeme? Was sollte algorithmischen Systemen erlaubt sein? Welche Konsequenzen sind bei Missbrauch oder Fehlern zu erwarten? Wie ist die Rechtsprechung dynamisch genug zu gestalten, um mit der schnellen Entwicklung technischer Systeme Schritt zu halten?

Ergebnisse: Leitlinien und Denkimpulse

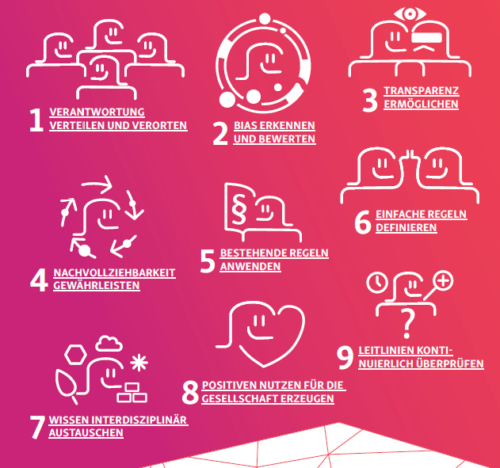

Die Ergebnisse wurden in drei Veröffentlichungen zu den Themen „Bias in algorithmischen Systemen“, „Transparenz und Nachvollziehbarkeit algorithmischer Systeme“ und „Verantwortung für algorithmische Systeme“ festgehalten und über die Projektlaufzeit der UAG kontinuierlich weiterentwickelt. Sie bilden die Basis für die 9 Leitlinien, die am 20. November 2019 öffentlich vorgestellt und diskutiert wurden:

- Verantwortung verteilen und verorten

Eine Vielzahl von Akteur*innen ist von der Beauftragung über die Entwicklung bis zum Einsatz an algorithmischen Systemen beteiligt. Klare und verbindliche Richtlinien zur Übernahme von Verantwortung für die einzelnen Phasen müssen formuliert werden. - Bias erkennen und bewerten

Bisher verborgene subjektive Wertungen können durch das Umsetzen in algorithmischen Strukturen sichtbarer werden. Da es keine algorithmischen Systeme ohne Bias geben kann, müssen klare und verbindliche Richtlinien zum Umgang mit diesen formuliert werden. - Transparenz ermöglichen

Durch die Komplexität algorithmischer Systeme können Fehlurteile, Fehlfunktionen und Bias oftmals nur schwer oder eingeschränkt erkannt werden. Ansprüche an Transparenz in algorithmischen Systemen müssen spezifisch umgesetzt werden. - Nachvollziehbarkeit gewährleiten

Algorithmische Systeme müssen von Anfang an so gestaltet werden, dass Prozesse im Nachhinein nachvollziehbar sind. Informationen über das System müssen gegenüber unterschiedlichen Nutzenden kontextbezogen dargestellt werden. - Bestehende Regeln anwenden

Neue gesetzliche Regelungen für algorithmische Systeme sind nicht zwingend erforderlich. Das bestehende Recht muss angewendet, für eine digitale Anwendung überprüft und gegebenenfalls angepasst werden. - Einfache Regeln definieren

Mit Mindeststandards sind algorithmische Systeme vergleichbarer. Dies kann zu mehr Vertrauen und Akzeptanz führen, wenn deren Einhaltung überprüfbar ist. - Wissen interdisziplinär austauschen

Die Qualität algorithmischer Systeme wird durch einen kontinuierlichen Austausch und gemeinsame Initiativen verbessert. Alle Akteur*innen tragen die Verantwortung zur Zusammenarbeit sowie zur Aneignung und Weiterentwicklung von Digitalkompetenzen. - Positiven Nutzen für die Gesellschaft erzeugen

Nur eine am Gemeinwohl orientierte Entwicklung und ein nachhaltiger Einsatz algorithmischer Systeme können ethischen Anforderungen langfristig gerecht werden. Dafür tragen Staat, Unternehmen und Zivilgesellschaft gleichermaßen die Verantwortung. - Leitlinien kontinuierlich überprüfen

Eine kontinuierliche Überprüfung von Leitlinien und Regeln liegt in der Verantwortung von entscheidenden Personen und bezieht alle Akteur*innen in die Überprüfung und Weiterentwicklung mit ein

Denkimpuls Digitale Ethik #10 | #AlgoMon: 9 Leitlinien zum ethischen Umgang mit Algorithmen-Monitoring

Die Leitlinien dienen beim Monitoring algorithmischer Systeme als Orientierung, wichtige Fragen nach der Verantwortlichkeit und Kontrolle, der Nichtdiskriminierung, der Transparenz und Nachvollziehbarkeit sowie der Nachhaltigkeit zu berücksichtigen. (Veröffentlichung: November 2019 – Leitlinien entstanden im Rahmen der UAG Algorithmen-Monitoring)

Denkimpuls Digitale Ethik #09 | Verantwortung für algorithmische Systeme

Die Verortung von Verantwortung sowie das vorausschauende Antizipieren von ethisch fraglichem oder rechtlich noch unklarem Handeln ist eine komplizierte Aufgabe. Zudem ist es oftmals die Komplexität der algorithmischen Systeme selbst, welche eine Rückführung von Verantwortung erschwert. (Veröffentlichung: November 2019 – entstanden im Rahmen der UAG Algorithmen-Monitoring)

Autor*innen: Corinna Balkow (Initiative D21 e. V.), Dr. Irina Eckardt (Initiative D21 e. V., KPMG)

Denkimpuls Digitale Ethik #08 | Transparenz und Nachvollziehbarkeit algorithmischer Systeme

In der Diskussion um transparente Gestaltung algorithmischer Systeme wird der Fokus oft auf die Bereitstellung von Informationen durch beteiligte Unternehmen gelegt. Dabei wird oft außer Acht gelassen, dass viele Menschen mit diesen Informationen wenig anfangen können. Sie brauchen eigentlich eine nachvollziehbare Aufarbeitung. (Veröffentlichung: Juni 2019 – entstanden im Rahmen der UAG Algorithmen-Monitoring)

Autor*innen: Corinna Balkow (Initiative D21 e. V.), Dr. Irina Eckardt (Initiative D21 e. V., KPMG)

Denkimpuls Digitale Ethik #07 | Bias in algorithmischen Systemen – Erläuterungen, Beispiele und Thesen

Bei der wachsenden Anwendung algorithmischer Systeme im Alltag stellen sich deren Einschränkungen als eine der entscheidenden Gerechtigkeitsfragen in der Digitalen Gesellschaft dar. Warum spielen sogenannte Bias in algorithmischen Systemen eine besondere Rolle? Wo kommen sie her, warum sind sie oft „menschengemacht“ und wie sollte damit umgegangen werden, um negative Folgen zu verhindern? (Veröffentlichung: März 2019 – entstanden im Rahmen der UAG Algorithmen-Monitoring)

Autor*innen: Corinna Balkow (Initiative D21 e. V.), Dr. Irina Eckardt (Initiative D21 e. V., KPMG)