AG-Blog | Datendemokratie im Superwahljahr

Die fortschreitende Digitalisierung macht auf vor den Wahlen nicht halt. Wie können wir die Daten aus digitalen Wahlen nutzen, um diese sicherer und demokratischer zu gestalten? Welche Herausforderungen und Gefahren ergeben sich daraus? Diesen und weiteren Fragen ist die AG Datendemokratie in ihrer Sitzung auf den Grund gegangen.

Berlin/virtuell. 2024 ist ein Superwahljahr – dieser Satz mag aktuell inflationär benutzt werden, die Bedeutung der rund um den Globus stattfinden Wahlen lässt sich aber kaum überschätzen: Ungefähr die Hälfte der Weltbevölkerung ist oder war in diesem Jahr zur Wahl aufgerufen. In vielerlei Hinsicht stehen wir in der Europäischen Union, in den USA aber auch in Indien vor richtungsweisenden Urnengängen.

Was haben nun aber Daten im Wahlkampf verloren? Wie wurde seit der Obama-Ära Social Media zu einem der wichtigsten Kampagnenmedien? Und wie kann unser AG-Name „Datendemokratie“ Realität werden? Diese Fragen hat die AG Datendemokratie unter der neuen Leitung von Paul Böttcher (PD – Berater der öffentlichen Hand) und Lilian Dammann (pub. Public Value Technologies) mit Expert*innen aus Forschung, Politik, Wirtschaft und Zivilgesellschaft bei der virtuellen Sitzung am 2. Juli besprochen.

Desinformation und demokratische Prozesse – was ChatGPT mit Wahlen zu tun hat

Den Anfang machte Caroline Lindekamp, Journalistin bei CORRECTIV und Leiterin des Projektteams CORRECTIV.Faktenforum. Sie gab den Teilnehmenden einen Überblick über die Arbeit des Faktenforums und die Möglichkeiten zur Nutzung von Systemen Künstlicher Intelligenz (KI) zum Faktenchecken von Nachrichten. Das CORRECTIV.Faktenforum ist ein Gemeinschaftsprojekt unter der Leitung des gemeinnützigen Medienhaus CORRECTIV in Kooperation mit verschiedenen Wissenschaftler*innen.

Gemeinsam soll das Verständnis von Desinformation in der Gesellschaft gesteigert und gleichzeitig Engagement für eine faktenbasierte öffentliche Debatte ermöglicht werden. Lindekamp erläuterte, dass Desinformation eine immer größere Bedrohung für unsere Demokratie darstelle. Es sei wichtig, Desinformation – also die bewusste Verbreitung von Falschinformationen – von „Missinformation“ zu unterscheiden.

Künstliche Intelligenz und Desinformation

Bei der Verbreitung von Desinformation würden heutzutage KI-Systeme eine immer größer werdende Rolle spielen. Lindekamp erklärte, wie es zu Falschinformationen durch KI-Systeme kommen könne: KI-Systeme wie ChatGPT antworten auf Anfragen in natürlicher Sprache, was den Nutzer*innen eine „künstliche Intelligenz“ suggeriere, die die Fragen verstehe und darauf antworten könne. Tatsächlich arbeiten die meisten Large Language Modelle (LLMs) jedoch mit Wahrscheinlichkeiten (der aufeinanderfolgenden Worte). Bei fehlenden Informationen in der Datenbank des LLMs könne es dadurch leicht zu „Halluzinationen“ kommen, wodurch das KI-System falsche Informationen oder falsche Fakten „erfinden“ könne. Auch wenn solche Vorfälle aktuell noch nicht so häufig Thema beim Fakten-Monitoring seien – in Zukunft werden sie eine immer größere Rolle spielen.

Der Fact-Checking-Cycle

Doch KI-Systeme können nicht nur zur Generierung und Verbreitung von Desinformation genutzt werden, sondern auch, um diese zu erkennen. Lindekamp erklärte, dass der gezielte Einsatz von KI-Systemen einzelne Schritte des Fact-Checking-Prozesses erleichtern könnte. Dazu arbeite CORRECTIV bereits an einigen Lösungen. Auf der Plattform des CORRECTIV.Faktenforums könne beispielsweise eine Community von ungefähr 100 Mitgliedern Falschmeldungen und Falschinformationen melden. Zurzeit laufe dies noch über einen Discord-Server, allerdings soll die Community langfristig auf eine eigene Plattform umziehen. So sollen Nutzer*innen neben der reinen Meldung von Desinformation auch mehr in den Prozess des Fact-Checkings miteingebunden werden. Außerdem gebe es den CORRECTIV.Faktencheck, bei dem Bürger*innen über WhatsApp Hinweise an einen Chatbot einsenden oder sich über neuste Faktenchecks und Recherchen informieren können. Zudem sei ein weiteres Projekt, der CORRECTIV.Checkbot, in Zusammenarbeit mit der TU Berlin in der Entwicklung. Dieser basiere auf dem LLM ChatGPT 3.5 von OpenAI. Auch hier sei es Priorität, eine transparente, erklärbare KI zu schaffen und zu nutzen:

Die Sorgfaltspflicht als Journalist*in muss immer gewährleistet sein, auch bei dem Einsatz von KI.

So sollen einzelne Prozesse heruntergebrochen werden und das LLM nur an einzelnen Stellen verwendet werden, sodass der Output kontrollierbar sei. Gleichzeitig könne der Checkbot nur auf die „private“ Datenbank von CORRECTIV zugreifen, die auf die Faktenchecks sowie auf Materialien aus der Reporterfabrik basiere und öffentlich zugänglich sei. Somit ließen sich Halluzinationen vermeiden. Zum Abschluss sprach sich Lindekamp für die Ausbildung der Medienkompetenz der Bevölkerung aus.

Der Ansatz der Medienkompetenzbildung sollte immer darin bestehen, den Menschen die Werkzeuge mitzugeben, um selbst Desinformation erkennen zu können, statt sich auf KI-Tools verlassen zu müssen.

Digitales Wählen bei der Europawahl, oder: Wie modernisiert man Wahlen?

Daran anknüpfend sprach Prof. Dr. Christoph Bieber, Forschungsprofessor für Digitale Demokratische Innovationen am Center for Advanced Internet Studies, über die Möglichkeiten des digitalen Wählens und gab dazu einige Beispiele. Er berichtete von seiner Arbeit im Forschungsprojekt Demokratische Innovationen, das daran arbeitet, digitale Wahlen beziehungsweise digitales Wählen beschreiben und erklären zu können. Spätestens mit der fehlerhaften Bundestagswahl 2021 in Berlin dürfte für viele der Modernisierungs- und Digitalisierungsbedarf des deutschen Wahlsystems ersichtlich geworden sein. Zurzeit würden die Wahlen in Deutschland und alle damit verbundenen Hintergrundprozesse sehr analog ablaufen. Zwar seien nun Konsequenzen gezogen und Abläufe verbessert sowie personelle Ressourcen gestärkt worden, dennoch bleibe die Debatte um den Einsatz von Technik bei der (Re-)Organisation von Wahlen weiterhin bestehen.

Digital ist woanders

Bieber richtete den Blick auf die in diesem Jahr stattgefundenen Europawahlen. Man könne lediglich bei drei von insgesamt 27 Mitgliedsstaaten – Estland, Belgien und Bulgarien – von digitalen Wahlen sprechen. Während zu den Wahlen in Estland bereits genauere Daten vorlegen, stünden die präzisieren Fallstudien für Belgien und Bulgarien noch aus. In Estland würden Online-Wahlen bereits seit 2005 angeboten. Zudem sei dort eine Stabstelle direkt im Parlament eingerichtet worden, die für die Organisation und Weiterentwicklung von Wahlen zuständig sei.

Wichtiger als die konkret eingesetzte Technologie ist aus meiner Sicht die institutionelle Ausstattung und Governance des Wahlprozesses.

So gebe es in Estland beispielsweise ein kontinuierliches Monitoring der digitalen Wahlprozesse. Seit der Einführung 2005 sei der Anteil an „E-Wähler*innen“ stetig angestiegen. Anders als bei der analogen Wahl gebe es bei Online-Wahlen eine längere Wahlperiode mit einem Countdown (über 7 Tage). Auch sei das Abändern oder Korrigieren der digitalen Stimme nach der Abgabe möglich. Dies diene unter anderem als Mittel gegen Bestechung oder das Erkaufen von Stimmen. Natürlich gebe es aber immer noch die Möglichkeit zur Abgabe einer analogen „Papierstimme“, die die digitale Stimme immer überschreibe.

In Bulgarien und (in Teilen von) Belgien habe es zwar keine Online-Wahlen, immerhin aber die Möglichkeit zur lokalen Nutzung von elektronischer Wahlgeräte („Wahlcomputer“) gegeben. In beiden Ländern seien „Voter-Verified Paper Audit Trail Verfahren“ zum Einsatz gekommen. Bei diesen Verfahren stimmen die Wähler*innen am Wahlcomputer ab und erhalten im Anschluss einen Papierstimmzettel als Ausdruck, der entweder gescannt und in die Urne geworfen werden müsse oder lediglich zur Überprüfung diene. In Bulgarien sei dieses Wahlverfahren sogar in den Gesetzestexten festgelegt. In Belgien seien bei einigen elektronischen Wahlgeräten Fehler aufgetreten. Zur Vermeidung solcher Fehler und zum Schutz der Wahlcomputer vor Manipulation arbeite man mit verschiedenen Vorgehensweisen (technische Limitierungen der Systeme, Standalone-Systeme ohne Internetanschluss, etc.)

Bieber erklärte, dass er die größten Probleme in der mangelnden Modernisierungsfähigkeit in Deutschland auf politischer und administrativer Seite sehe. Es brauche die Stärkung des Vertrauens der Bevölkerung durch Institutionen und Politik – beispielsweise durch das Schaffen entsprechender Gremien, etc.:

Wir können nicht warten, bis alle rechtlichen und technischen Eventualitäten bis ins letzte Detail geklärt sind, sonst kommen wir mit den technologischen Entwicklungen nicht mehr hinterher.

Online-Wahltools in Deutschland

Zum Abschluss schaute sich Jan Wegner, Geschäftsführer von Polyas, gemeinsam mit den Teilnehmenden die Möglichkeiten zu Online-Wahlen in Deutschland genauer an. Auch wenn es noch keine digitalen politischen Wahlen gebe, seien Online-Wahlen bereits in vielen anderen Bereichen der Gesellschaft erfolgreich umgesetzt worden, zum Beispiel die Bundessozialwahl 2023. Bei Online-Wahlen gelte ebenso die Einhaltung der Wahlgrundsätze wie bei analogen Wahlen. Um die Geheimhaltung der Wahlen zu sichern, würden beispielsweise bestimmte kryptografische Verfahren eingesetzt, um Wähler*in und Stimmzettel unumkehrbar voneinander zu trennen. Zur Nachvollziehbarkeit der Wahl gebe es verschiedene Verifizierungsmöglichkeiten wie die universelle oder individuelle Verifikation oder auch eine digitale Wahlbeobachtung wie in Estland. Zudem gebe es in Deutschland seit 2018 einen internationalen Standard für nicht-politische Online-Wahlen, das Common Criteria Schutzprofil, vom Bundesamt für Sicherheit in der Informationstechnik.

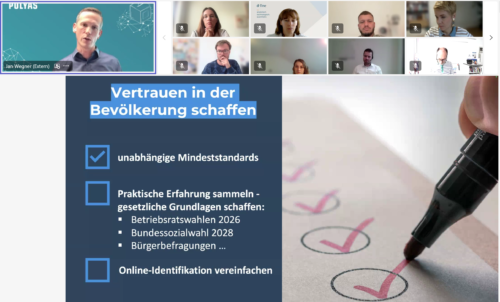

Vertrauen in der Bevölkerung schaffen

Auch Wegner betonte, wie wichtig es sei, in der Bevölkerung Vertrauen in digitale Wahlprozesse zu schaffen. Hierzu seien unabhängige Mindeststandards ebenso wichtig wie das Sammeln praktischer Erfahrungen für das politische Wahlspektrum außerhalb der politischen Wahlen – beispielsweise bei den Online-Betriebswahlen 2026, der Bundessozialwahl 2028 oder bei Bürger*innenbefragungen. Gleichzeitig sei es wichtig, die Online-Identifikation zu vereinfachen, die die Grundlage für eine verifizierbare Online-Wahl darstelle. Grundsätzlich solle man den Wähler*innen das Wählen so leicht wie möglich machen, denn:

Auch wenn Online-Wahlen nicht direkt mit einer höheren Wahlbeteiligung in Verbindung gebracht werden können, sehen wir doch am Beispiel von Estland, dass sie vor allem durch eine höhere Vielfalt an Wahlmöglichkeiten gesteigert werden kann.

Wegner schloss sich der Aussage von Bieber an und betonte ebenfalls den Handlungsbedarf bei der Umsetzung digitaler Wahlprozesse. Er spreche sich bewusst gegen eine sequenzielle Umsetzung digitaler Wahlprozesse aus, weil er glaube, dass er diese Umsetzung sonst selbst nicht mehr erleben werde.

Die Teilnehmenden waren sich einig, dass Desinformation eine Bedrohung für unsere Demokratie darstellt und wir die Möglichkeiten zur Bekämpfung dieser nutzen sollten, seien es KI-gestützte Fakten-Monitoring oder die Ausbildung der Medienkompetenzen der Bürger*innen. Gleichzeitig diskutierten die Anwesenden noch lange über die Potenziale und den Handlungsbedarf bei der Modernisierung der Wahlen in Deutschland.