AG-Blog | Digital-ethische Leitplanken der Zukunft

Welche digitale Zukunft wünschen wir uns? Die Arbeitsgruppe Digitale Ethik hatte sich in der letzten Sitzung des Jahres vorgenommen, in die Zukunft zu schauen und den Blick auf technologische Entwicklungen und aktuelle Forschung im Kontext ihrer digital-ethische Implikationen zu richten. Vor dem Hintergrund der enormen Dynamik und Komplexität der aktuellen Weltlage lag der Fokus auf den heutigen Gestaltungsmöglichkeiten für die digitale Welt der Zukunft.

Berlin/virtuell. Drei konkrete Forschungsszenarien aus unterschiedlichen Fachgebieten und ihre technischen Potenziale standen bei der virtuellen Sitzung am 30. November 2022 beispielhaft im Mittelpunkt: Neurostimulation, Robotik und Web3. Nach Kurzinputs von Expert*innen auf dem jeweiligen Gebiet diskutierten die AG-Mitglieder in Kleingruppen ganz konkret über digital-ethische Leitplanken und Besonderheiten der Herausforderungen für die Zukunft des jeweiligen Bereichs: Welche Wirkung erwarten wir von den kontinuierlichen und für ein Individuum nicht in Gänze erfassbaren Entwicklungen der Technik? Und mit welchem Ziel wollen wir wie mit den Technologien umgehen?

Narrative und Menschenbilder der Digitalisierung

Als Grundlage für die ethische Diskussion dieser Praxisperspektiven erinnerte Dr. Nikolai Horn vom iRights-Lab als Co-Leiter der AG Digitale Ethik in einem philosophischen Impuls an die Narrative und Menschenbilder, die der Diskussion um digitalen Wandel zugrunde liegen. In Anlehnung an Schriften von Prof. Petra Grimm identifizierte Horn drei Stoßrichtungen von Narrativen, mit denen wir auf die Digitalisierung blicken können: Beim „Pandora-Narrativ“ sei das Ausschalten von Bedrohungspotenzialen durch schnellstmögliche Regulierung handlungsleitend; beim „Hermes-Narrativ“, das dem Pandora-Narrativ entgegenstehe, werde die Digitalisierung vor allem als Fortschrittsmacher angesehen, mit dem Probleme gelöst werden können. Das „Prometheus-Narrativ“ wiederum suche einen abwägenden Mittelweg aus den beiden anderen:

Wie es auch die Arbeitsweise unserer Arbeitsgruppe ist, betrachtet man im Prometheus-Narrativ die Potenziale der Digitalisierung wohlwollend, identifiziert aber gleichzeitig diejenigen Aspekte, die gesteuert und/oder reguliert werden müssen.

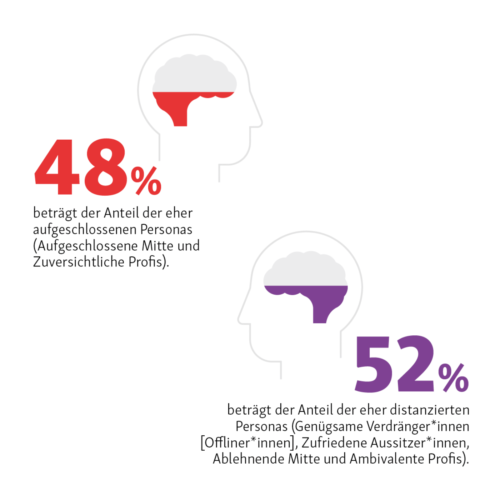

Neben dem Bewusstsein über solche Narrative in der digital-ethischen Diskussion sei auch das Wissen um unterschiedliche Menschenbilder wichtig für eine holistische Diskussion unserer digitalen Zukunft. Es hänge nämlich vom intrinsischen Menschenbild ab, welche Entwicklung wir als „gut“ ansehen und welche ethisch relevanten Forderungen daraus entstehen: „Beim behavioristischen Menschenbild, das den Menschen vordergründig durch sein Verhalten definiert, würde man zum Beispiel die Möglichkeiten psychometrischer Verhaltenssteuerung anders beurteilen, als nach dem kollektivistischen Menschenbild, das den Menschen als freies Gemeinschaftswesen mit einer einzigartigen Fähigkeit, durch den Geist immer wieder neue die Selbst- und Weltbilder zu schaffen, ansieht“, erörterte Horn. Wenn wir nun bestimmte Menschenbilder übergeneralisieren und zum Zentrum unseres Diskurses machen – vielleicht sogar, ohne uns ihrer bewusst zu sein – drohe eine Auffassung vom Menschen, die wichtige Facetten ausblendet; wir tappen in die Reduktionismusfalle. Daher sei es besonders wichtig, den Blick auf den Menschen in seiner Vielfalt zu schärfen, wenn man über digital-ethische Leitplanken für die Zukunft diskutiere.

Simone Kaiser vom CeRRI Fraunhofer IAO stellte als Co-Leitung der Arbeitsgruppe anhand einer Revue der vergangenen Sitzung den Transfer zu den Menschenbildern der Digitalisierung her. Mit Beispielen wir der ökologischen Nachhaltigkeit oder dem Spannungsfeld von Daten im Gesundheitswesen öffnete Kaiser den Raum für das Zusammendenken von Menschenbilder, Narrativen und digital-ethischen Leitplanken. Dies im Hinterkopf ging die Arbeitsgruppe in die Diskussion über drei praktische Beispiele von Zukunftstechnologien und deren ethischen Implikationen.

Die Zukunft der (nicht-invasiven) Neurostimulation

Neurostimulation bedeutet, dass man Nerven mithilfe von Stromimpulsen stimuliert – mit dem Ziel, damit bestimmte Effekte zu erzielen; findet das Ganze im Gehirn statt, nennt man es Hirnstimulation. Anwendungsgebiete könnten zum Beispiel die Behandlung oder auch die Diagnose bestimmter Krankheiten sein. Aktuell findet dies vor allem noch in der Erforschung solcher Krankheiten statt, was streng reguliert wird. Im Heimbereich gebe es aber auch jetzt schon einen noch weitestgehend unregulierten Markt für zum Beispiel Leistungssteigerung oder Bewusstseinsveränderung, betonte Dr. Moritz Maier vom Fraunhofer IAO in seinem Impuls. Er stellte der AG vor, was in Zukunft mit nicht-invasiver Hirnstimulation – also ganz ohne Öffnung der Schädeldecke – möglich sein könnte.

Wenn Technik und Methodik sich verbessern, sei eine deutlich zielgerichtetere Anwendung der Hirnstimulation möglich als noch heute. Digitale Schnittstellen und der Einsatz von künstlicher Intelligenz bei der Auswertung der Daten würden einen individualisierteren Einsatz ermöglichen. Die Geräte würden dann auch günstiger werden und stärkere Verbreitung finden. Dadurch könnten bei der Behandlung bestimmter psychischer und neuronaler Erkrankungen Therapeut*innen und Psychiater*innen entlastet werden – aber auch eine noch stärkere Durchdringung eines Privatmarktes für Leistungssteigerung stattfinden.

Dabei sollten wir nicht vergessen, dass die unüberwachte Anwendung außerhalb von Kliniken und Forschungseinrichtungen auch unsachgemäßen Gebrauch mit sich bringt – das Gesundheitssystem wird also mit Behandlungen aufgrund von fehlerhafter Anwendung zu tun bekommen.

Digital-ethische Fragestellungen, die sich aus möglichen Entwicklungen der nicht-invasiven Hirnstimulation ergeben:

- Wie können neurologische Daten von Anwender*innen geschützt werden?

- Wie kann mit dem Spannungsfeld zwischen geschützten Algorithmen und dem berechtigten Interesse von Nutzenden auf vollständige Information bzgl. ihrer Hirnstimulation umgegangen werden?

- Was ist eigentlich Krankheit? Was wollen wir mit Neurostimulation „behandeln“, was ist nur Wellness – und muss letzteres strenger reguliert werden? Wie gehen wir damit um, falls Hirnstimulation zu Abhängigkeiten führt?

- Neurowissenschaftliche Forschung findet vorwiegend im globalen Norden statt. Wie kann sichergestellt werden, dass effizienzsteigernde Algorithmen nicht diskriminieren oder bestimmte Bevölkerungsgruppen gefährden?

- Wie kann mit einer zu erwartenden Monopolisierung von Anbietern von KI-gestützten Geräten für nicht-invasive Hirnstimulation umgegangen werden?

Die Zukunft der Robotik

Roboter sind mehr als ein Spielzeug – richtig eingesetzt besteht die Hoffnung, dass sie uns Menschen körperliche Arbeit abnehmen und das Leben erleichtern. Einer, der an ihnen forscht, ist Dr. Michael Gienger vom Honda Research Institute Europe (HRI). In seinem Impuls für die Arbeitsgruppe machte er fünf große Felder auf, in denen Entwicklungen in der Robotik in naher Zukunft große Schritte machen könnte. In Bezug auf Telepräsenz könnten in Zukunft durch Roboter Distanzen überwunden werden. Neuartige Human-Machine-Interfaces ermöglichen das Teilen von Autonomie zwischen Mensch und Roboter. So könnten schon bald taktiles Fühlen auf Distanz oder auch Avatare mit echtem menschlichen Ausdruck möglich werden. In eine ähnliche Richtung geht die Entwicklung bei Social Robots: Diese können immer besser mit Menschen interagieren und kommunizieren und so zum Beispiel dafür eingesetzt werden, ältere Menschen zu ihrem nötigen Training zu bewegen.

Bezüglich Pflegerobotern, die im Diskurs über die Zukunft der Robotik häufig einen großen Raum einnehmen, sei die Entwicklung noch nicht so weit, wie man häufig denke. Das Ziel seien ganzheitliche Unterstützungssysteme, nicht Roboter, die einzelne Schritte der Pflege übernehmen – und das sei auch gleichzeitig die Herausforderung. Physically Capable Robots wiederum hätten aktuell noch eine Limitierung bei der Perzeption und Robustheit. Im Bereich der kooperativen Robotik in Bezug auf Arbeit tue sich aktuell viel:

Tatsächlich geht es hier auch um die Modellierung eines Menschen, wie wir es uns häufig in der Science Fiction vorstellen.

Roboter und Mensch würden sich bei verschiedenen Arbeitsschritten die Autonomie unterschiedlich aufteilen – wobei den Entwicklung davon weg gehe, dass der Mensch jeden Schritt des Roboters überwachen müsse. Vielmehr sei der Blick in Zukunft darauf gerichtet, echtes kollaboratives Arbeiten zu ermöglichen.

Digital-ethische Fragestellungen, die sich aus möglichen Entwicklungen der Robotik ergeben:

- Gibt es gesellschaftliche Bereiche, die wir Robotern nicht überlassen wollen? Wenn ja, wie können sie definiert werden und was unterscheidet sie von den Bereichen, die in denen wir Unterstützung von Robotern nutzen wollen?

- Was ist der Mensch in der Kommunikation mit robotischen Systemen? Benötigen die Systeme eine Einschätzung des menschlichen Interaktionspartners, um zum Beispiel interkulturelle Unterschiede zu erkennen? Wie lässt sich so etwas diskriminierungsfrei gestalten?

- Ist es in Ordnung, wenn Roboter emotionale Nähe suggerieren?

- Wie lässt sich in der Interaktion mit einem Roboter Transparenz und Nachvollziehbarkeit für Anwender*innen schaffen? Wenn wir nicht wollen, dass ausschließlich Roboter sich selbst erklären – welche Stellen wollen wir für die Erklärung und Zertifizierung einsetzen? Wie lassen sich solche Instanzen so objektiv wie möglich gestalten?

- Wie können wir Forscher*innen für ihre Verantwortung in der Roboterentwicklung sensibilisieren? Was braucht es dafür in der Ausbildung? Wie lässt sich Missbrauch durch demokratiefeindliche Personen/Organisationen vorbeugen?

Die Zukunft des Web3

Das Web3, über das schon jetzt in bestimmten Kreisen als „die Zukunft des Internets“ gesprochen wird, entwickelt sich erst seit ungefähr 13 Jahren. Web3-Expertin Anna Graf von Arvato Systems beschrieb den Entwicklungsprozess in ihrem Impuls so: Zunächst hätte das Web3 ein Nischendasein innegehabt; so hätte beispielsweise die Kunstwelt versucht, den Wert von digitaler Kunst darüber besser zu beziffern und Künstler*innen zu entlohnen. Inzwischen gebe es jedoch einen Hype um das Web3, insbesondere im Zusammenhang mit Währungen wie Bitcoin, NFTs (Non-Fungible Tokens, die ein eindeutiges Eigentumsrecht verleihen) und der allgemeinen Nutzung von Blockchain-Technologie: „Web3 wird deshalb so oft als die Zukunft des Internets betrachtet, weil es die Möglichkeit bietet, dezentrale Wallets und Speichersysteme zu verwenden, die nicht von einer zentralen Stelle abhängig sind. Wie dezentral sie wirklich sind und welche neuen Intermediäre sich dabei herausbilden, ist aber eine wichtige Frage bei der Auseinandersetzung mit der Technologie“, analysierte Graf.

Es gebe außerdem starke Bedenken hinsichtlich der Nachhaltigkeit, weil aktuell mit vielen Web3-Anwendungsfällen ein enorm hoher Stromverbrauch einhergeht, der die Leistung von Rechenzentren für konventionelle Internetanwendungen weit übersteigt. Auch die möglichen Machtkämpfe, die sich aus der Verbreitung von Web3 ergeben, werden im aktuellen Diskurs stark problematisiert:

Es ist jetzt an uns, zu gestalten und Regeln zu setzen, die ein gutes Zusammenleben in der digitalen Welt ermöglichen, insbesondere jetzt in der frühen Phase der Entwicklung von Web3.

So charakterisierte Graf die chancenorientierten Facetten der aktuelle Debatte. Die Tatsache, dass bald über eine Milliarde Menschen Nutzende des Web3 seien, führe in jedem Fall dazu, dass man es nicht einfach ignorieren könne.

Digital-ethische Fragestellungen, die sich aus möglichen Entwicklungen des Web3 ergeben:

- Kann erreicht werden, dass Web3 durch Dezentralisierung mehr Gleichheit herstellt, anstatt Ungleichheit neu zu verteilen? Und falls es nicht erreicht werden kann – welche Berechtigung hat Web3 dann?

- Wie kann die Zivilgesellschaft in den aktuell noch sehr wirtschaftsorientierten Web3-Entwicklungsprozess eingebunden werden, sodass eine Gemeinwohlorientierung möglich wird?

- Wie kann sichergestellt werden, dass die ethischen, aber auch die juristischen Bewertungen der analogen Welt im Web3 ebenfalls funktionieren?

- Wie gehen wir mit Monopolbildung von finanzstarken Playern um? Sollten Interoperabilität von Technologien sowie Datenportabilität sichergestellt werden – und wenn ja, wie müssen Regulierungen für die neuen Intermediäre aussehen?

- Wie können wir ethisch schlechte Entwicklungen durch das Web3 (z. B. Terrorismusfinanzierung, Geldwäsche) verhindern?

- Wie kann ökologische Nachhaltigkeit besser beachtet werden?

Digital-ethische Diskussionsräume schaffen

Die fruchtbaren Diskussionen in der Arbeitsgruppe machten deutlich, dass unser Einblick in die Technologien, ihre Konsequenzen sowie die damit einhergehenden digital-ethischen Fragestellungen ein Privileg ist und eine Verantwortung mit sich bringt. Alle Beteiligten sollten versuchen, dieser Verantwortung gerecht zu werden und den gesellschaftlichen Diskurs voranzubringen. Ziel müsse sein, Menschen zu enablen, informierte Entscheidungen zu treffen. Dafür sind interdisziplinäre Diskursräume, die alle Perspektiven betrachten und abwägen, unerlässlich. Als einen solchen Raum sehen die Mitglieder auch die Arbeitsgruppe Digitale Ethik. Wir freuen uns schon jetzt darauf, diese Diskussionen auch im neuen Jahr gemeinsam weiterzuführen.

Wahl der AG-Leitung

Den Abschluss der AG-Sitzung bildete die turnusgerechte Wahl der AG-Leitung. Die amtierenden Vorsitzenden Simone Kaiser (CERRI Frauenhofer IAO) und Dr. Nikolai Horn (iRights Lab) konnten nach zwei Jahren AG-Leitung satzungsgemäß nicht noch einmal kandidieren. Ihnen gebührt großer Dank für die fantastische Zusammenarbeit! Nicht nur die kluge Diskussionsleitung, die philosophischen Impulse von Dr. Nikolai Horn und die Einblicke aus der Forschung von Simone Kaiser werden uns gut in Erinnerung bleiben.

Wir gratulieren Dr. Sarah J. Becker (idigiT – Institute for Digital Transformation in Healthcare) und Jens-Rainer Jänig (mc-quadrat | Vorstandsmitglied der Initiative D21) zur Wahl als neue AG-Leitung und freuen uns auf das, was kommt. Herzlichen Glückwunsch!