AG-Blog | Ein Jahr mit ChatGPT: Auswirkungen auf die Digitale Gesellschaft im Fokus

In welchen Bereichen unseres Lebens findet ChatGPT statt und welche Veränderungen hat es ausgelöst? Anlässlich des 1. Geburtstags der Veröffentlichung von ChatGPT hat die AG Bildung gemeinsam mit der Digital Future Challenge im Rahmen der Dialogreihe „Digital Responsibility“ u. a. darüber diskutiert, welche Perspektiven es jetzt zu berücksichtigen gilt und welche digitalen Kompetenzen in den Fokus der Bildung rücken müssen.

Berlin/virtuell. „Mit ChatGPT erleben wir einen neuen iPhone-Moment.“ Diese Parallele wird im aktuellen Diskurs immer wieder gezogen. Teilweise wird die Markteinführung des iPhones rückblickend sogar als „Revolution“ bezeichnet. In jedem Fall war es eine bedeutende technologische Innovation, die sich auf breite Teile der Gesellschaft ausgewirkt hat. Das war 2007 noch nicht in diesem Maße absehbar. Was hat es nun aber mit dem „revolutionären“ Charakter von ChatGPT auf sich? In welchem Ausmaß hat es die digitale Gesellschaft ein Jahr nach seiner Einführung am 30. November 2022 wirklich verändert? In welchen Bereichen unseres Lebens – ob Alltags- oder Arbeitswelt – findet ChatGPT bewusst oder unbewusst statt? Welche Anwendungsfälle gibt es, welche gesellschaftlichen Entwicklungen können wir beobachten und sind (neue) digitale Kompetenzen unabdingbar?

Anlässlich dieses 1. Geburtstags der Veröffentlichung von ChatGPT hat die AG Bildung gemeinsam mit der Digital Future Challenge im Rahmen der Dialogreihe „Digital Responsibility“ eine virtuelle Veranstaltung ausgerichtet. Jan Quaing von der Deutschen Bundesstiftung Umwelt führte durch die Sitzung, die sich inhaltlich in vier Teile gegliederte: Nach einem Lagebild zur Digitale Gesellschaft und ChatGPT ging es um Veränderungen in der Gesellschaft, der Wirtschaft sowie um neue Kompetenzanforderungen, was mit einem kleinen Promptathon abgeschlossen wurde.

Lagebild: Die Digitale Gesellschaft und ChatGPT

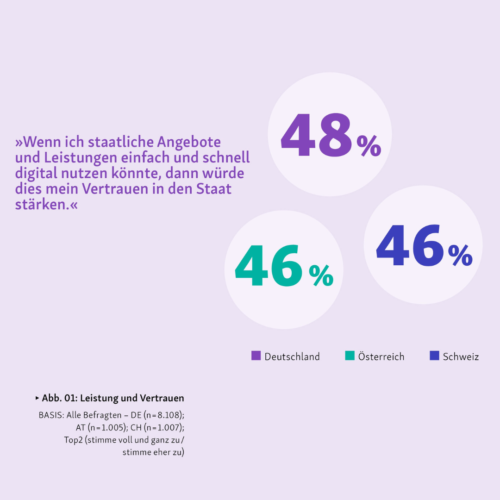

Sandy Jahn, Referentin für Strategic Insights & Analytics bei der Initiative D21, gab den Teilnehmenden gestützt durch Erkenntnisse aus dem D21-Digital-Index ein Lagebild der Digitalen Gesellschaft in Bezug auf generative Künstlicher Intelligenz (KI) im Allgemeinen und ChatGPT im Speziellen. Die rasante (Weiter-)Entwicklung im KI-Bereich sei ein Treiber der digitalen Transformation in so gut wie allen Lebensbereichen. Die Bürger*innen stünden den damit einhergehenden Veränderungen zwiespältig gegenüber: Während knapp die Hälfte eine eher optimistische Einstellung gegenüber der digitalen Transformation einnimmt, blickt der Rest eher skeptisch darauf. Diese verschiedenen Herangehensweisen wiederum hätten eine Auswirkung auf ihre Resilienz gegenüber Entwicklungen im Digitalen Wandel, so Jahn.

Resilienz beschreibt die Zukunftsfähigkeit unserer Gesellschaft: Wie werden wir in Zukunft mit Entwicklungen im digitalen Wandel umgehen können?

Aktuell seien nicht alle in Deutschland fit für den digitalen Wandel und würden Gefahr laufen, abgehängt zu werden: Laut D21-Digital-Index gelten nur 61 Prozent der Bevölkerung in diesem Punkt als resilient.

In Bezug auf KI werde deutlich, dass Entwicklungen in vielen Lebensbereichen immer rascher aufeinander folgen. Dies löse in Teilen der Gesellschaft ein Gefühl der Überforderung aus, so Jahn – vor allem, weil KI im Alltag mittlerweile spürbar angekommen sei. Ungefähr ein Drittel der Bevölkerung (ab 14 Jahre) hat laut D21-Digital-Index bereits bewusst eine KI-Anwendung genutzt – und bereits 7 Monate nach der Einführung von ChatGPT hatten 18 Prozent es ausprobiert. Generative KI habe eine enorme Transformationskraft; entscheidend werde sein, wie diese genutzt werden wird.

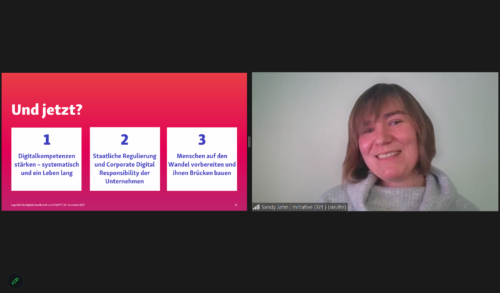

Jahn gab drei Handlungsempfehlungen, die sich aus diesen Erkenntnissen ableiten:

- Digitalkompetenzen stärken, systematisch und ein Leben lang. Durch Wissen im Umgang mit digitalen Technologien könne Mut und Neugier in der Gesellschaft aufkommen, neue Dinge in der digitalen Welt auszuprobieren, was wichtig für die Herausbildung der digitalen Resilienz ist.

- Staatliche Regulierungen und verstärkte Corporate Digital Responsibility in Unternehmen, z. B. die verpflichtende Kennzeichnung von KI-generierten Inhalten. Auch fehle es an Transparenz der Quellen von Informationen, die ChatGPT liefert. Aber auch Unternehmen seien in der Verantwortung, Werte wie Fairness, Datenschutz und Diskriminierungsfreiheit bei generativer KI sicherzustellen.

- Menschen auf den Wandel vorbereiten und ihnen Brücken bauen, sodass niemand abgehängt werde. Dazu brauche es Strukturen, die den Bürger*innen ermöglichen, die Vorteile neuer Technologien selbst zu erleben. Der eigene Nutzen sei einer der größte Treiber für Veränderungs- und Anpassungsbereitschaft

Wie verändert ChatGPT unsere Gesellschaft?

Probleme mit Wahrhaftigkeit und fehlend etablierte Quellenkritik

Dr. Johanna Sprondel, Direktorin der Urania Berlin, schloss daran an mit Überlegungen zu verschiedenen gesellschaftlichen Herausforderungen, die sich aufgrund der verbreiteten Nutzung von ChatGPT ergeben haben. Sie würde in der Bevölkerung eine enorme (positive) Erwartungshaltung gegenüber KI erkennen, so Sprondel. Diese positive Einstellung komme durch die vielen Arbeitserleichterungen zustande. Zu selten werde deshalb das Problem der Authentizität oder Wahrhaftigkeit von generativer KI und deren Ergebnissen diskutiert. Bei Bildern sei sich die Bevölkerungen der Gefahr von Deep Fakes und von KI erstellten Inhalten bewusst, gegenüber Texten sei man aber weniger empfindlich: Schon vor der Einführung von ChatGPT vor einem Jahr habe die Bevölkerung Desinformation nicht zuverlässig erkennen können. Seitdem sei Quellenkritik als Kompetenz kaum gestärkt worden.

ChatGPT könne Textstile sehr originalgetreu nachempfinden. Selbst, wenn keine manipulierende Absicht vorliege, sei es dabei nicht immer faktentreu, so Sprondel. Damit ergebe sich in Bildung nun eine Herausforderung:

Damit eine zuverlässige Nutzung von ChatGPT gewährleistet werden kann, ist es erforderlich, Hintergrundwissen und Praktiken zu erlernen und anzuwenden, die darauf abzielen, die Wahrhaftigkeit von Inhalten zu überprüfen. Das erfordert aber Zeit und Kompetenzen, die derzeit nicht ausreichend berücksichtigt werden oder deren Notwendigkeit in der Gesellschaft nicht ausreichend erkannt wird.

Einsatzmöglichkeit und Grenzen von ChatGPT in Kulturerbe-Einrichtungen

Clemens Neudecker, Projektleiter bei der Staatsbibliothek zu Berlin (Stabi), stellte die Möglichkeiten vor, die sich in seiner Organisation durch KI ergeben haben. Die Stabi besitze eine große Menge an Daten mit hoher Qualität. Diese Daten hätten bisher jedoch kaum Eingang in KI-Modelle gefunden. Ein Grund dafür sei, dass viele von ihnen nicht digital zugreifbar seien. Das Ziel der Stabi sei es daher, analoge Inhalte digital aufzuarbeiten, sodass diese Inhalte einfach durchsucht werden können. Seit knapp acht Jahren widme man sich bereits dem maschinellen Lernen, um zum Beispiel die Text-Bild Suche zu implementieren und Scans in digitale Text zu verwandeln und mit Verlinkungen zu versehen.

Die Stabi als öffentliche Informationseinrichtung sieht ihre Rolle in Bezug auf generative KI dementsprechend in der Aufarbeitung und Bereitstellung von qualitativ hochwertigen Daten, unter Berücksichtigung eines ethischen und verantwortungsvollen Umgangs damit.

Zwar sei die Ausstattung mit Personal und Finanzierung im Vergleich zum privaten Wirtschaftssektor nicht besonders groß, doch seien einige Kulturerbe-Einrichtungen gewillt, ihre Kräfte zu bündeln. Die daraus entstehende internationale, partizipatorische Community wolle eine offene und transparente KI, so Neudecker. Es sei wichtig, dass die Zivilgesellschaft die Gestaltung von KI nicht ausschließlich der freien Wirtschaft überlasse und die Interpretation der KI-generierten Inhalte nicht komplett aus der Hand gebe. Entscheidend sei letztlich nicht allein die Technologie, sondern die Kultur des Umgangs damit.

Wie verändert ChatGPT die Wirtschaft?

Praxisbericht: Wie ChatGPT Wissensmanagement und Rechercheprozesse optimiert

Auch auf die Arbeitswelt hatte ChatGPT seit seiner Veröffentlichung große Auswirkungen. Dazu teilte Thomas Weber, Partner bei McKinsey, einen Erfahrungsbericht. Bei McKinsey sei früher mit einem Wissensmanagementsystem gearbeitet worden, in dem von allen Mitarbeitenden internen Daten, Erhebungen und Kontaktdaten gespeichert wurden. Durch ChatGPT würden sich nun weitere Anwendungsfälle für diese Plattform bieten. Zum Beispiel habe man eine Kontextualisierung der Suche durch ChatGPT implementiert – das stetige Spezifizieren der Fragestellung und das Generieren von Inhalten. Als Minimum Viable Product habe McKinsey diese ChatGPT-Implementierung für alle bereit gestellt:

Unsere interne generative KI „Lilli“ ist mit allen internen Daten von McKinsey gefüttert, sodass sie Inhalte auf deren Basis generieren kann. Sie liefert die zugehörigen Quellen und stellt die nötigen Kontaktdaten der jeweiligen Expert*innen, die an der Gewinnung der Informationen beteiligt waren, zur Verfügung. Auf sensible und vertrauliche Daten unserer Klient*innenarbeit kann Lilli nicht zugreifen.

Die Arbeit der Berater*innen bei McKinsey könne Lilli keinesfalls ersetzen, jedoch bei der Recherche und Vorformulierungen unterstützen. Mit nur geringen Anpassungen könne man Lilli in Zukunft auch auf andere Organisationen anpassen.

Sozialforschungsperspektiven auf ChatGPT und dem Arbeitsmarkt

Prof. Dr. Martin Ehlert, Forschungsgruppenleiter am Wissenschaftszentrum Berlin für Sozialforschung WZB, legte den Teilnehmenden aus der Perspektive der Sozialforschung den Zusammenhang zwischen digitalen Assistenzsystemen (wie ChatGPT) auf der einen und dem Arbeitsmarkt auf der anderen Seite dar. Zunächst merkte er an, dass es anders als oft kolportiert bisher noch keine gravierenden Einflüsse auf den Arbeitsmarkt gegeben habe, weder positive wie bei der Bekämpfung des Fachkräftemangels, noch negative. Dennoch würden digitale Assistenzsysteme ein riesiges Potential bergen. Aktuell werde ChatGPT im Arbeitsprozess hauptsächlich dazu benutzt, Fachfragen zu beantworten und Texte zu erstellen oder zu bearbeiten; deshalb seien die aktuellen Nutzungsszenarien von ChatGPT auf bestimmte Berufe beschränkt.

Ehlert drei Szenarien vor, die sich in Bezug auf Qualifikationsanforderungen in der Arbeitswelt durch ChatGPT auf lange Sicht ergeben könnten:

- Upskilling: In diesem Szenario würde die Technologie die langweiligen Fleißaufgaben übernehmen und die arbeitenden Menschen könnten sich neuen Kompetenzen widmen.

- Deskilling: In diesem Szenario würde den arbeitenden Menschen nur noch wenig abverlangt – nämlich stumpfe Tätigkeiten beim Bedienen von Technologien und Maschinen, die das meiste übernehmen.

- Spaltung: In diesem Szenario käme es zu einem Upskilling der einen und zu einem Deskilling der anderen. Dieses Szenario halte er für am wahrscheinlichsten

Am Ende wird ausschlaggebend sein, ob die Fähigkeiten der Menschen von Technologien erweitert oder überflüssig gemacht werden.

Abschließend gab Ehlert einen kurzen Einblick in neueste Forschungsergebnisse. So seien beispielsweise Nutzer*innen von digitalen Assistenzsystemen, die Texte erstellen und Fachfragen beantworten wie ChatGPT, meist höher gebildet, müssten im Beruf häufiger schreiben und hätten weniger Angst vor Arbeitsplatzverlust als diejenigen die die Systeme nicht nutzen. Allerdings fühlten sie sich dafür häufiger fremdbestimmt, so Ehlert.

Wie verändert ChatGPT die Kompetenzanforderungen?

Digitale Transformation an Schulen: Förderung von Kompetenzen im Umgang mit KI

Damit wurde der Bogen geschlagen zu den neuen Ansprüchen an Kompetenzen und die Umsetzung in der Bildung. Stefan Schönwetter, Leiter Digitale Bildung bei der Deutsche Kinder- und Jugendstiftung (DKJS), berichtete von den Ergebnissen einem Pilotversuchs im Rahmen des Programms bildung.digital namens „KI im Klassenzimmer“. Zeil sei gewesen, Schulen bei der digitalen Transformation zu unterstützen und ihnen den Zugang zu dem KI-basierten Textgenerator ChatGPT über schulKI zu ermöglichen. Der Einsatz von KI-basierten Tools sei vom Projektteam in allen Fächern außer Sport begleitet und mit Unterstützung der Lehrkräfte und Schüler*innen ausgewertet worden.

Vor dem eigentlichen Unterricht hatten die Lehrkräfte das System zur Unterrichtsvorbereitung und Aufgabendifferenzierung nutzen können. Die bereitgestellten Inhalte konnten dann von den Schüler*innen direkt genutzt werden. Ebenfalls bewährt hätten sich Personas, mit denen Schüler*innen sich „unterhalten“ konnten, so Schönwetter. Dies habe die Lehrkräfte enorm entlastet, auch wenn es momentan noch Probleme damit gebe, dass einige Personas zu detailliert antworten würden oder fehleranfällig seien. Den Schüler*innen müsse dabei ein kritischer Blick vermittelt werden: Ihnen müsse klar sein, dass die generierten Inhalte keinen Wahrheitsanspruch besitzen, sondern auf Wahrscheinlichkeiten beruhen würden, so Schönwetter. Seine Schlussfolgerung:

Ich möchte dafür werben, bestehende Kompetenzmodelle mit der Schablone der KI zu betrachten und in der täglichen Praxis neu zu justieren, statt ganz neue Kompetenzmodelle zu erarbeiten.“

Zum Beispiel müsse das Kompetenz-Feld „Kollaboration“ nun auf Mensch-Maschinen Interaktion erweitert werden. Außerdem müsse Medienkompetenz gestärkt werden, sodass KI-generierte Inhalte erkannt werden. Vor allem müsse das Lernen gelernt werden – Schüler*innen müssten verstehen, was sie durch den Einsatz von KI lernen können, ohne dass es zu einem Deskilling komme.

Zwischen Kompetenz und Compliance: Prompathons

Sindy Leffler-Krebs, Compliance Managerin bei der Deutschen Telekom, teilte zum Abschluss einen ganz praktischen Ansatz dafür, wie der Kompetenzaufbau rund um die Nutzung von ChatGPT in einem Unternehmen gestaltet werden könne. Bei der Deutschen Telekom beschäftige man sich bereits seit Februar 2022 mit Handlungsempfehlungen zu KI für Mitarbeitende. Dabei sei deutlich geworden, dass die Kompetenzen und das Bewusstsein für den Umgang weiter gestärkt werden müssten. Daher habe man einen Prompathon (Wortneuschöpfung aus „prompten“ + „Marathon“) ins Leben gerufen. Die Veranstaltung habe den Mitarbeitenden in verschiedenen Teams und in business-nahen Challenges beigebracht, was gute Prompts sind und wie man diese beispielsweise bei ChatGPT eingeben müsse, um mit seiner Hilfe z. B. kreativ Aufgaben zu lösen – und das, ohne die wichtigen Anforderungen an Compliance außer Acht zu lassen.

Unser Promptathon war so strukturiert, dass eine iterative Verbesserung der Ergebnisse durch kollegiale Beratung zwischen den Prompts möglich war. Damit wollen wir das Wissen und die technischen Kompetenzen über KI erhöhen. Darüber hinaus war uns der der Mensch als letzte Instanz sehr wichtig.

Auch die heutige Veranstaltung endete mit einem kleinen Prompathon, in dem die Teilnehmenden das Gelernte selbst anwenden konnten. In einem Denkimpuls von Dr. Marie Blachetta, Referentin für Corporate Responsibility bei der Initiative D21, wurde deutlich, dass es zusätzlich zum kompetenten Prompten, bei dem etwa auf Aspekte wie Persona, Kontext oder auch Tonalität eingegangen werden kann, auch die Perspektive des verantwortungsvollen Promptens gebe. ChatGPT habe bereits ein Pop-Up etabliert, um Nutzer*innen darüber aufzuklären, keine sensiblen Informationen zu teilen, Fakten noch mal zu überprüfen und ChatGPT nicht als einzigen Ratgeber zu nutzen. Zusätzlich müsse man aber drei weitere Perspektiven beachten, welche im Rahmen der diesjährigen Digital Future Challenge in den Fokus genommen werden:

- die ökologische Perspektive (Beispiel: Nicht nur das Training, auch die Nutzung von KI-Systemen ist sehr ressourcen-intensiv.)

- die soziale Perspektive (Beispiel: Bei der Nutzung müsse man beachten, dass man kein Bias reproduziere.)

- die Governance-Perspektive (Beispiel: Es gelte, keine Urheberrechtsverletzungen zu begehen und Inhalte entsprechend zu kennzeichnen.

Anschließend konnten sich die Teilnehmenden in drei Challenges selbst ausprobieren: die Einkaufsliste für ein Weihnachtsmenü planen, Grundprinzipien eines digitalen Verhaltenskodizes erstellen oder ein Theaterstück mit der digital-politischen Jahresvorschau für 2024 schreiben lassen.

Der Umgang mit KI-Tools wie ChatGPT erfordert die Berücksichtigung verschiedener Perspektiven und den Aufbau digitaler Kompetenzen, wobei Maßnahmen wie Prompathons helfen könnten. Es sei jedoch wichtig, Upskilling-Maßnahmen so zu gestalten, dass sie nicht zu einer Spaltung in der Gesellschaft führen, und gleichzeitig ethische Aspekte und veränderte Kompetenzanforderungen im Kontext von KI angemessen zu berücksichtigen, schloss Moderator Quaing.

Weitere Termine der virtuellen Dialogreihe